Neue KI-Modelle, Open-Source-Aufstieg und KI-Tools: Was die aktuelle KI-Woche für Ihr Unternehmen bedeutet

Eine Milliarde Parameter. Auf einer einzigen GPU. Open Source. Was vor zwei Jahren noch undenkbar war, ist heute Alltag im KI-Markt. Die aktuelle Entwicklungswoche bringt neue Flaggschiff-Modelle, überraschende Verschiebungen im Open-Source-Bereich und Werkzeuge, die den Arbeitsalltag in deutschen Unternehmen konkret verändern. Wer jetzt nicht hinschaut, übersieht eine Weggabelung.

GPT-5.5 und die OpenAI-Roadmap: Agentische KI nimmt Fahrt auf

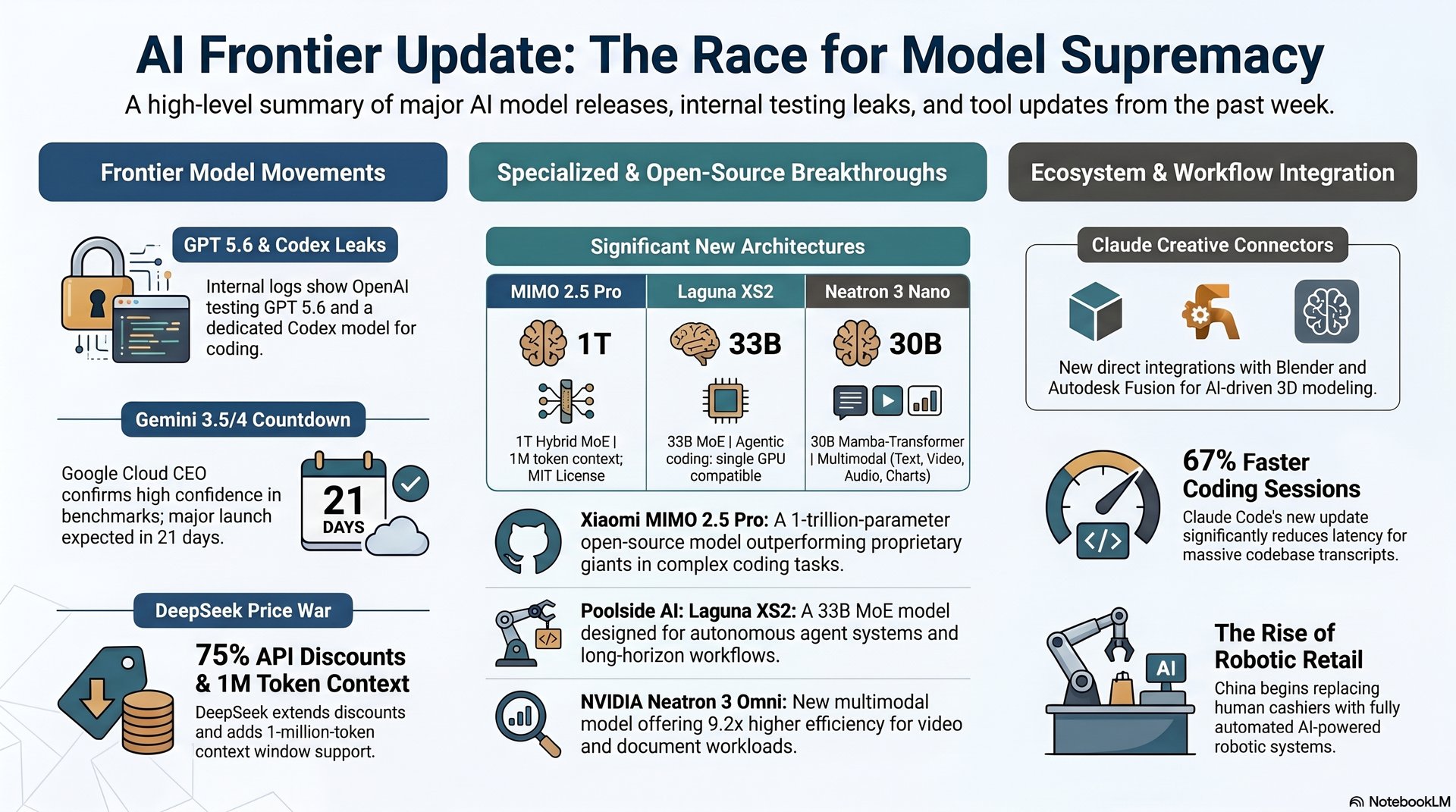

OpenAI hat GPT-5.5 veröffentlicht — und die internen Logs des Unternehmens deuten bereits auf die nächsten Schritte hin: GPT-5.6 und GPT-5.5 Codex, eine spezialisierte Variante für Programmieraufgaben, stehen offenbar in der Pipeline. Was auf den ersten Blick wie eine Versionsnummer klingt, ist in der Praxis eine wesentliche Verschiebung.

GPT-5.5 ist nicht primär für Chat-Gespräche konzipiert. Das Modell ist auf agentische Workflows ausgelegt: Es führt mehrstufige Aufgaben eigenständig aus, bedient Software, navigiert in Systemen. Für einen Steuerberater in Hamburg bedeutet das: Mandantenunterlagen einlesen, Posten prüfen, Vorbericht strukturieren — ohne dass jemand die Zwischenschritte überwacht. Die Fehlerquote sinkt, weil das Modell nicht nach dem ersten Satz abbricht, sondern denkt und prüft.

Die OpenAI-Roadmap zeigt zudem, dass die Spezialisierung zunimmt. GPT-5.5 Codex wird explizit für Code-intensive Aufgaben entwickelt. Unternehmen mit eigener Softwareentwicklung — oder solche, die externe Entwickler beauftragen — sollten das im Blick behalten: KI-gestützte Code-Reviews, automatisierte Test-Generierung und Dokumentationserstellung werden bei dieser Modellklasse zum Standard.

Open-Source-Modelle auf Augenhöhe: MIMO 2.5 Pro und Laguna XS2

Während OpenAI und Google die Schlagzeilen dominieren, passiert etwas Entscheidendes im Open-Source-Bereich: Modelle, die frei verfügbar und auf eigener Hardware betreibbar sind, schließen die Leistungslücke zu proprietären Top-Modellen — schneller als erwartet.

Xiaomis MIMO 2.5 Pro hat 1 Billion Parameter insgesamt, davon 42 Milliarden aktiv, und ein Kontextfenster von 1 Million Token. Zum Vergleich: Ein Kontextfenster dieser Größe kann den vollständigen Inhalt mehrerer tausend Seiten Fachliteratur auf einmal verarbeiten. Für einen Kanzleibetrieb, der komplexe Vertragswerke prüfen muss, oder ein Ingenieurbüro mit umfangreicher technischer Dokumentation ist das keine theoretische Übung — es ist ein echter Produktivitätsgewinn.

Poolside AIs Laguna XS2 geht in eine andere Richtung: 33 Milliarden Parameter, davon 3 Milliarden aktiv, lauffähig auf einer einzigen GPU. Kein Rechenzentrum, kein Cloud-Vertrag, keine Datenweitergabe an externe Anbieter. Für Handwerksbetriebe in München oder Produktionsunternehmen im Mittelstand, die sensible Kundendaten verwalten und Datenschutz ernst nehmen, ist lokale KI keine Kompromisslösung mehr — sie ist vollwertiger Ersatz. Der entscheidende Unterschied zu früher: Die Einrichtung erfordert keine spezialisierte IT-Abteilung. One-Click-Deployments werden marktreif.

Ergänzend dazu: DeepSeek V4 Pro ist über die API bis zum 31. Mai um bis zu 75 Prozent rabattiert. Wer Open-Source-Modelle erproben möchte, ohne sofort in eigene Hardware zu investieren, hat hier ein konkretes Zeitfenster.

KI-Programmierwerkzeuge und Multimodalität: Was sich im Arbeitsalltag ändert

Claude Code, das KI-Coding-Tool von Anthropic, ist 67 Prozent schneller bei der Verarbeitung von Dateien über 40 Megabyte. Das klingt nach einem technischen Detail — aber für jeden, der mit größeren Code-Basen, umfangreichen Datenbankskripten oder komplexen Konfigurationsdateien arbeitet, ist das der Unterschied zwischen einem nützlichen Werkzeug und einem, das man tatsächlich täglich einsetzt.

Noch relevanter ist die Integration von Claude Code in Blender und Autodesk Fusion. Beide Programme werden in der Produktgestaltung, im Maschinenbau und in der Architektur eingesetzt. Wenn KI direkt im Werkzeug verankert ist — nicht als separate Anwendung daneben — ändert sich der Workflow grundlegend. Ein Maschinenbauer kann Designvarianten sprachgesteuert generieren lassen, ohne die gewohnte Oberfläche zu verlassen. Das ist keine Zukunftsvision; das ist die aktuelle Version.

Auf der Seite der Multimodalität setzt Nvidias Neatron 3 Nano Omni einen neuen Maßstab: 30 Milliarden Parameter, 256.000 Token Kontextfenster, Text, Video und Audio in einem Modell vereint, mit einer 9,2-fach höheren Video-Systemeffizienz gegenüber der Vorgängergeneration. Was das für den Mittelstand bedeutet: Kundengespräche transkribieren, Videoanleitungen automatisch untertiteln, Produktpräsentationen in mehrere Sprachen übersetzen — alles in einem System, ohne Medienbrüche.

Dass in China KI-Roboter bereits Kassierer im Einzelhandel ersetzen, ist für deutsche Unternehmen kein direkter Handlungsaufruf. Es ist ein Indikator dafür, in welcher Geschwindigkeit multimodale KI-Systeme aus dem Labor in den operativen Betrieb wandern. Die Frage ist nicht ob, sondern wann diese Entwicklung mitteleuropäische Branchen erreicht.

Google I/O in 21 Tagen: Was Unternehmen erwarten können

Googles Entwicklerkonferenz steht bevor — und die Erwartungen sind konkret: Gemini 3.5 oder Gemini 4 werden erwartet. Für Unternehmen, die bereits Google Workspace nutzen, ist das unmittelbar relevant. Gemini ist tief in Gmail, Docs, Sheets und Meet integriert. Jede Verbesserung des Grundmodells wirkt sich direkt auf diese Werkzeuge aus.

Was bedeutet das praktisch? Ein Vertriebsteam, das täglich Angebote formuliert und Kundenanfragen per Mail beantwortet, profitiert von einem stärkeren Sprachmodell im Hintergrund, ohne neue Software einzuführen. Die KI verbessert sich im bestehenden System. Das ist der Unterschied zwischen KI als Projekt und KI als Infrastruktur.

Für IT-Entscheider gilt: Google I/O ist keine Messe für Technikbegeisterte. Es ist der Moment, an dem sich entscheidet, welche KI-Funktionen in den nächsten zwölf Monaten in jedem deutschen Büro verfügbar sein werden — ob bewusst genutzt oder nicht.

Was jetzt zu tun ist — konkret und ohne Umwege

Die aktuelle Entwicklungswoche zeigt drei Richtungen gleichzeitig: Flaggschiff-Modelle werden leistungsfähiger und agentischer, Open-Source-Modelle schließen die Lücke und ermöglichen lokalen Betrieb ohne Cloud-Abhängigkeit, und Programmierwerkzeuge werden schneller und tiefer in bestehende Software integriert.

Für deutsche KMUs ergibt sich daraus eine klare Handlungslogik: Wer KI heute erprobt, kann in einem Jahr auf eine ausgereifte Grundlage aufbauen. Wer wartet, holt gegenüber Wettbewerbern auf, die bereits routiniert damit arbeiten.

Drei konkrete erste Schritte, unabhängig von Branche und Unternehmensgröße: Erstens, einen internen Prozess identifizieren, der repetitiv und datenintensiv ist. Zweitens, prüfen, ob Datenschutzanforderungen für diesen Prozess einen lokalen Betrieb notwendig machen. Drittens, eine strukturierte Bewertung der verfügbaren Modelle durchführen — ohne Bindung an einen einzelnen Anbieter.

Der Markt konsolidiert sich, aber er schließt sich nicht. Die Auswahl ist heute so groß wie nie, und die Einstiegshürde so niedrig wie nie. Das ist eine Gelegenheit — aber eine mit Halbwertszeit.

Sie wollen wissen, welche dieser neuen KI-Modelle und Werkzeuge konkret zu Ihrem Unternehmen passen? GO-ITC berät Sie praxisnah, ohne Technik-Jargon und ohne Verkaufsshow. Kein Lock-in, keine Buzzwords — nur das, was für Ihr Unternehmen tatsächlich sinnvoll ist. Besuchen Sie go-itc.de für ein unverbindliches Erstgespräch.